面对GPT-4,NLP工程师还是有办法的

〇、题记

- 到底是“左右逢源”还是“举步维艰”,让子弹飞一会儿吧。

- 所谓技术壁垒也许就是如何更清晰有效的描述需求了,但也很难形成技术壁垒。至于专利,软件著作权保护的是制作软件这个技术本身,而非你使用软件时的姿势,所以我想单独的prompt 应该也不会形成专利,但是作为你某个技术的一部分,还是有可能的。

- LLM 现阶段的表现是“懂开车的人才能开车”,所以需要更多更懂某个业务,更熟练使用LLM 工具的人。

这篇文章的目标:讨论在当前GPT-4 如此强大的技术冲击下,普通NLP 算法工程师该何去何从。本文章主要用来引发思考+讨论,如果您是NLP算法工程师,有什么新的观点或者Comment,可以加微信Alphatue

首先说下结论:GPT-4 非常强大,但是我们认为,还没有到彻底取代NLP 算法工程师工作的地步,依然有很多能做的方向。本文分为以下几部分:

一、GPT-4厉害在哪里?

二、GPT-4存在的问题

三、NLP工程师可以努力的方向

四、何去何从

五、申请Prompt专利?我们会不会失业?

一、GPT-4厉害在哪里?

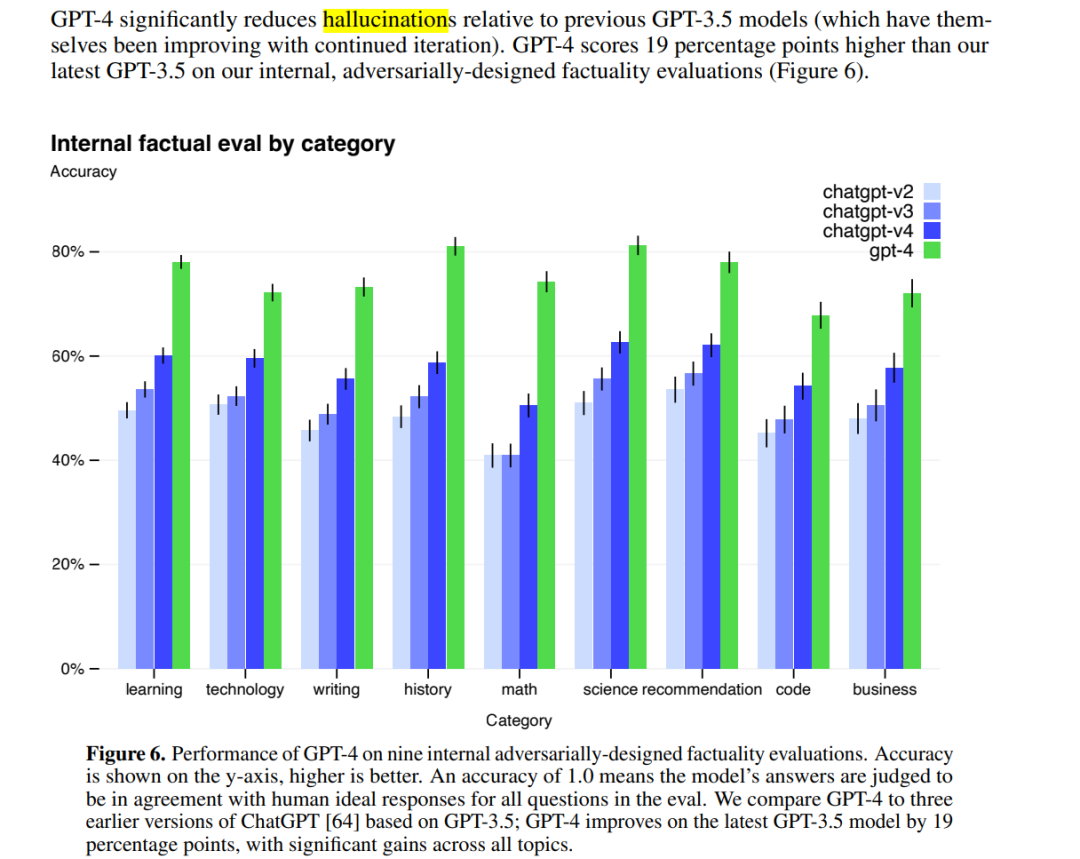

1.更可靠了(胡说八道进一步降低)为什么?详情可见OpenAI的GPT-4 Technical Report(下图) 具体意思是,和以前的GPT-3.5模型相比,GPT-4大大减少了胡说八道的情况。

性能更好:比GPT-3.5 又提升了一大截

性能更好:比GPT-3.5 又提升了一大截

具体表现在哪?根据论文里的例子,我们发现GPT-4在技术上有几个进步:

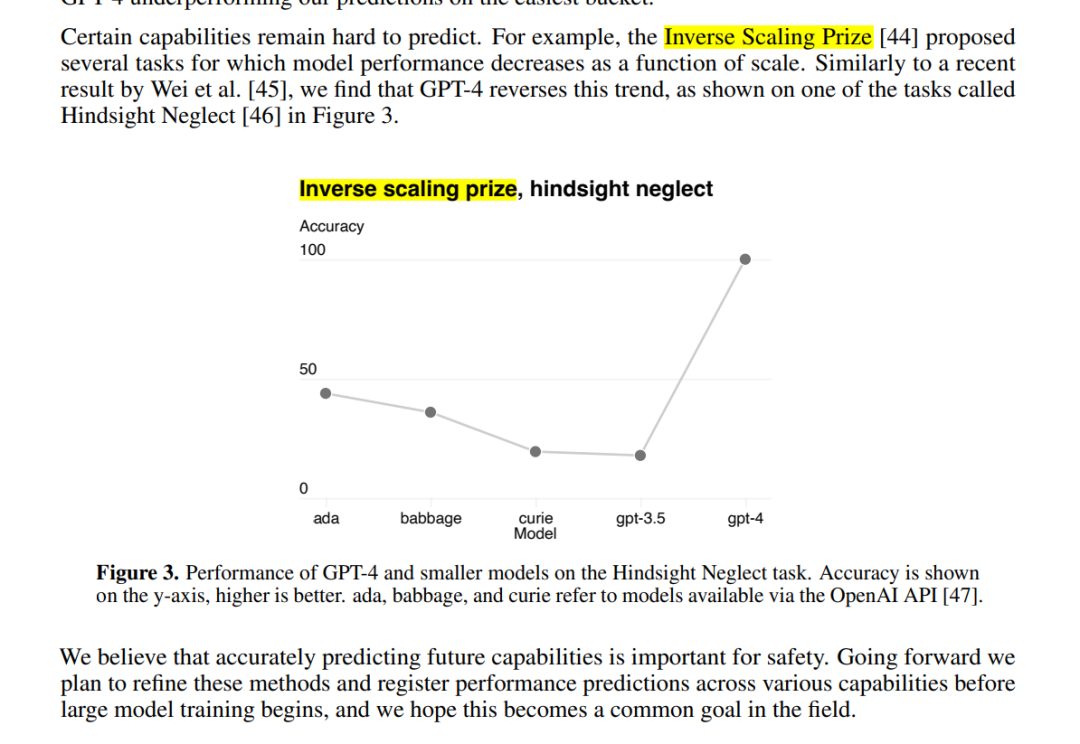

- 第一,多模态处理能力:GPT-4可以接受包含文本和图片的输入,并生成包括自然语言和代码在内的文本输出。这使得它在处理文档、图表或屏幕截图等任务时表现出色。第二,更好的性能和表现:相比前代GPT-3.5,在处理复杂任务时表现更为出色,在各大面向人类的考试中展示出了更高的准确性、可靠性、创造力和理解能力。第三,Test-Time Techniques扩展能力:GPT-4使用了Test-Time Techniques如few-shot和chain-of-thought prompting进一步扩展了其能力,使其能够更好地处理新领域和任务。第四,安全性优化:GPT-4重视安全性,生成回复的正确性得到了重点优化。它还进行了对抗性真实性评估,以避免潜在的安全隐患。第五,开源框架支持:OpenAI开源了用于评价大语言模型的开源框架OpenAI Evals,可以帮助研究人员和开发者评估他们的模型,并提供更好的指导。第六,模型训练和监控:OpenAI强调对模型进行评估和监控的重要性,以避免潜在的安全隐患。GPT-4也已被应用在了OpenAI内部,例如内容生成、销售和编程,并在模型训练的第二阶段负责输出评估、对齐工作。这里我们也抛一个问题:(究竟如何定义“模型的性能?”模型越来越难评估了,比如说,市场认为的某些某些不如chatgpt,但是也有人测试觉得更好,是怎么定量的评估呢?)3.Reverse inverse scaling prize:一些随着模型变大性能下降的任务,在GPT-4上不再出现类似现象(曾经没法通过增大模型规模提升性能的任务现在也解决了)如何理解reverse inverse scaling prize?通过阅读论文原文,Inverse Scaling Prize 提出的几个任务,模型性能会随着scale的扩大而下降,但是我们发现GPT-4扭转了这一趋势。也就是说,GPT-4 scale扩大,性能也不会下降。见下图:

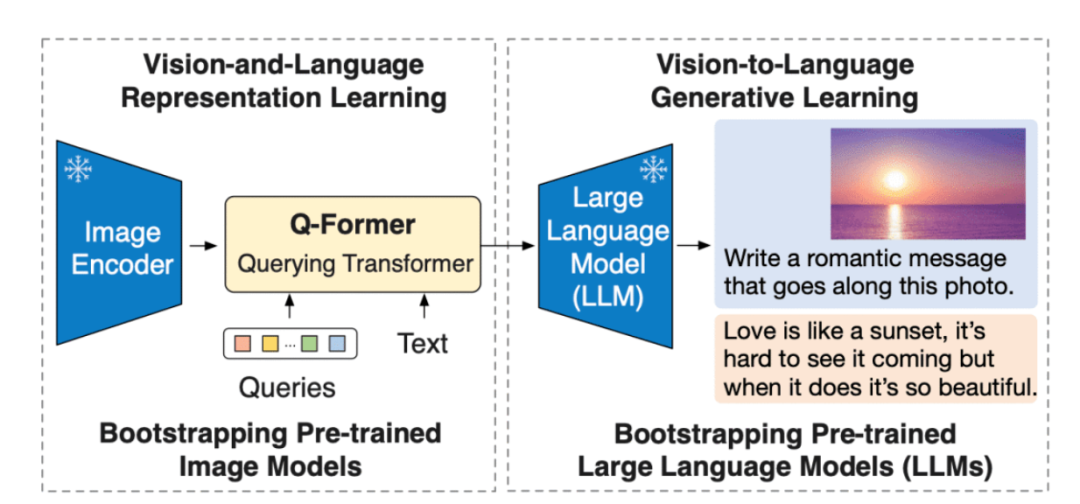

能够用图像做prompt:增加图像信息能进一步提升性能(看图说话,类似BLIP2,这个对视力存在问题的朋友太友好了)

能够用图像做prompt:增加图像信息能进一步提升性能(看图说话,类似BLIP2,这个对视力存在问题的朋友太友好了)

啥是BLIP2?论文:https://arxiv.org/pdf/2301.12597.pdf

Salesforce 研究院的 BLIP-2 模型,是一种视觉语言模型,可以用于图像字幕生成、有提示图像字幕生成、视觉问答及基于聊天的提示等多种应用场景。BLIP-2 通过引入一种新的视觉语言预训练范式来解决端到端视觉语言预训练的高成本问题,并实现了在多个视觉语言任务上最先进的结果,同时减少了训练参数量和预训练成本。

Salesforce 研究院的 BLIP-2 模型,是一种视觉语言模型,可以用于图像字幕生成、有提示图像字幕生成、视觉问答及基于聊天的提示等多种应用场景。BLIP-2 通过引入一种新的视觉语言预训练范式来解决端到端视觉语言预训练的高成本问题,并实现了在多个视觉语言任务上最先进的结果,同时减少了训练参数量和预训练成本。

二、GPT-4存在的问题

1.不开源

由于GPT-4 完全不公布任何技术细节,所以为什么它有如此强大的能力,我们只能猜,想要研究它变得困难重重。

2.数据安全

ChatGPT 的火爆让大家突然忘了曾经非常看重的数据安全问题,preview 版是有可能会参与下次迭代的;而商用API即使强调不会用于模型训练,敏感业务数据你敢用吗?

3.资源消耗大

即使是GPT-3 也有175Billion(1750亿) 参数,所有的训练/推理都是极其消耗资源的,从GPT-4 的价格上涨了50% 来看,我们认为GPT-4 的推理消耗资源也上升了约50% 左右。

三、NLP工程师可以努力的方向

这也是最近讨论比较热烈的一个问题。在我们探讨这个问题之前,可以先思考一下理想的NLP 模型应该具有哪些特征。我们认为,比较理想的模型是:

安全可靠/支持长文本/小/快/私有化部署。

所以从个人观点出发,给出一些我们比较关注的方向,抛砖引玉:

1.hallucination

目前LLM 最大的问题就是hallucination(hallucination举个例子,就是ChatGPT会一本正经的胡说八道)。那么目前主流两种思路:alignment/多模态。①alignment:alignment 就是让模型理解人类语言

②多模态:多模态(Multimodality)是指涉及多个感官或媒体形式的信息处理和表达方式。在自然语言处理和计算机视觉等领域,多模态通常是指同时处理和理解多种输入方式,如文本、音频和图像等。多模态信息处理可以帮助计算机更好地理解复杂的人类交互和情境,从而提高计算机的智能化水平和应用效果。例如,在图像字幕生成任务中,计算机需要同时处理图像和文本,根据图像内容生成相关的文字描述。

- Alignment 至于如何做alignment ,学术界主要是instruction-tuning为主,OpenAI 的路线是RLHF,然而普通玩家我是完全不推荐做RL的,只要仔细阅读InstructGPT/GPT-4 paper中关于reward model 部分就能劝退了(原因:因为Reward model太难做啦,你要用模型来模拟人的偏好,贼难...instructgpt里是直接过拟合训的,gpt4是加了一堆规则)。所以对于我们普通玩家,是否有别的路径?

- 多模态 GPT4 的Paper上看,效果是不错的,不过我们目前还在实践,欢迎实践过的同仁来讨论。

2.复现GPT-4/ChatGPT/GPT-3.5/InstructGPT

不开源只能复现,目前主要有[facebookresearch/llama](https://github.com/facebookresearch/llama)/[bigscience/bloom](https://huggingface.co/bigscience/bloom)此外还有不开源但是可以使用API 访问的百度文心一言/ChatGLM 等。

3.如何评估LLM

很多人提到百度文心一言性能“不够好”,具体指的是哪里不够好?想要回答这个问题,就涉及到:究竟如何量化评估LLM 的性能?曾经自动化的方案及 Benchmark 的参考意义,随着LLM 的能力提升显得越来越弱,现在急需新的数据集/评估方案。目前的工作有:[openai/evals](https://github.com/openai/evals)[stanford-crfm/HELM](https://github.com/stanford-crfm/helm)

4.支持长文本

更长的输入,对某些任务是有利的,那么如何让模型支持更长的输入?

主要的思路有两个:

- 训练时使用较短文本,推理时外推更长的位置信息,使模型获得处理长文本的能力,如bloom 中使用的[ALiBI](https://arxiv.org/pdf/2108.12409.pdf)

- 调整模型结构,如最近的工作:[CoLT5:Faster Long-Range Transformers with Conditional Computation](https://arxiv.org/pdf/2303.09752.pdf)

PS: GPT-4 的输入从GPT-3.5 的4K(or 8K">低成本fine-tuning 主要有两个方向:①parameter-efficient②sample-efficient.parameter-efficient的思路目前主要有prompt-tuning/prefix-tuning/LoRA/Adapter 等

参考[huggingcae/peft](https://github.com/huggingface/peft)

- sample-efficient 可以帮助我们如何更有效的构造训练集

最近的工作有[Simfluence: Modeling the Influence of Individual Training Examples by Simulating Training Runs](http://arxiv.org/abs/2303.08114)

8.优化器

优化器决定了我们训练时需要的资源。虽然我们通常使用Adam 优化器,但是其需要2倍额外显存,而google 好像用Adafactor 更多一点,最近他们又出了一个新工作

- [Lion](https://arxiv.org/abs/2302.06675).

9.更可控

如从可控生成角度看,目前可控主要通过control token(prompt)来实现,有没有更好的办法来实现更“精细”的控制?正如controlnet 之于stable diffusion。

10.识别AIGC

如何判别内容是人写的还是模型生成的呢?随着模型的性能越来越强,识别AIGC 也越来越困难。目前的工作也有watermark/[GPTZero](https://gptzero.me/) 等不过我感觉还没什么特别有效的方案目前。对此我有个简单的思路:将AI 生成的与非AI 生成的看作是两种不同的语言,如code 与英语一样,虽然都是相同符号构成,但是对应不同语言。使用大量的AI 生成的内容(或人机交互数据)pretrain 一个”AI 语言模型“,再来进行识别。

11.单一任务/领域刷榜

我认为在某个任务/领域上通过小模型挑战大模型依然有意义,LLM 虽然强大,但是依然有太多我们不知道的能力,通过小模型刷榜也许能提供一些思路,就像PET 本意是挑战GPT-3,却打开了LLM 的新思路。

四、何去何从

1.普通工程师

这种新的革命性的技术我们普通工程师通常都不是第一线的,我们第一次真正使用bert 也是在其出来两年后了。即使今天,也有很多场景/公司不使用bert这个技术。换个角度,即使我们想参与,我想能参与训练/fine-tuning 一个10B 规模模型的工程师都相当少,更别提更大的了。所以到底是“左右逢源”还是“举步维艰”,让子弹飞一会儿吧。

2.普通用户

生活中不缺少美,而是缺少发现美的眼睛。对于普通用户来说,要努力提高自己的鉴别能力(究竟什么是真?什么是假?什么是好?什么是坏?)

五、番外

1.通过Prompt构建技术壁垒/申请prompt 专利

随着alignment 的进一步优化,LLM 通常越来越理解自然语言,所以我们认为prompt-trick 越来越不重要,而清晰地用prompt 描述你的需求越来越重要。所谓技术壁垒也许就是如何更清晰有效的描述需求了,但也很难形成技术壁垒。至于专利,软件著作权保护的是制作软件这个技术本身,而非你使用软件时的姿势,所以我想单独的prompt 应该也不会形成专利,但是作为你某个技术的一部分,还是有可能的。

2.会不会失业

我们认为不会失业,但会转变一部分人的工作方式。在计算这件事上,人类早已被计算机远远地甩在后面,而计算机的出现也带来了大量的新工作。尤其是LLM 现阶段的表现是“懂开车的人才能开车”,所以需要更多更懂某个业务,更熟练使用LLM 工具的人。

1.资讯内容不构成投资建议,投资者应独立决策并自行承担风险

2.本文版权归属原作所有,仅代表作者本人观点,不代表本站的观点或立场

您可能感兴趣

-

解读CKB版 “闪电网络” Fiber Network:比特币可编程性扩展的另一种思路

解读CKB版 “闪电网络” Fiber Network:比特币可编程性扩展的另一种思路作者:NingNing行业周期与宏观金融周期共振,加密行业正处在与 2019 年相似的整体性迷茫之中,现阶段不仅流动性枯竭,叙事貌似也在枯竭。市场不但对 VC 叙事兴趣阙如,对反 VC 的 Meme 叙事也已经疲倦。就像每次哲学危机,人们都会回归柏拉图寻找出路,当加密行业危机时,我们也需要回归比特币、回归中本聪。正如 CKB 生态 RGB++ 协议创始人 Cipher 在最新 Blog 里所阐述的,加密行业需要对以太坊 “链上计算” 的路径依赖进行反思,回归P2P经济学,让计算归于链下,让验证归于链上。因

-

面对NFL球员工会起诉,“退圈”的DraftKings竟主动承认NFT是证券?

面对NFL球员工会起诉,“退圈”的DraftKings竟主动承认NFT是证券?作者:Zen,PANews近日,美国国家橄榄球联盟球员协会 (NFLPA) 指控数字体育娱乐和游戏公司DraftKings 逃避了其 NFT 球员许可协议的付款义务。在放弃NFT业务后,涉嫌出售未注册证券而遭到集体诉讼的DraftKings又背上了一起官司。而有趣的是,在与NFLPA的纠纷中,DraftKings的立场似乎已从反驳转变为积极承认“NFT就是证券”。放弃NFT业务:驳回集体诉讼的动议遭到否决今年7月底,Draftkings在给用户的电子邮件中表示:“经过慎重考虑,DraftKings 决定终

-

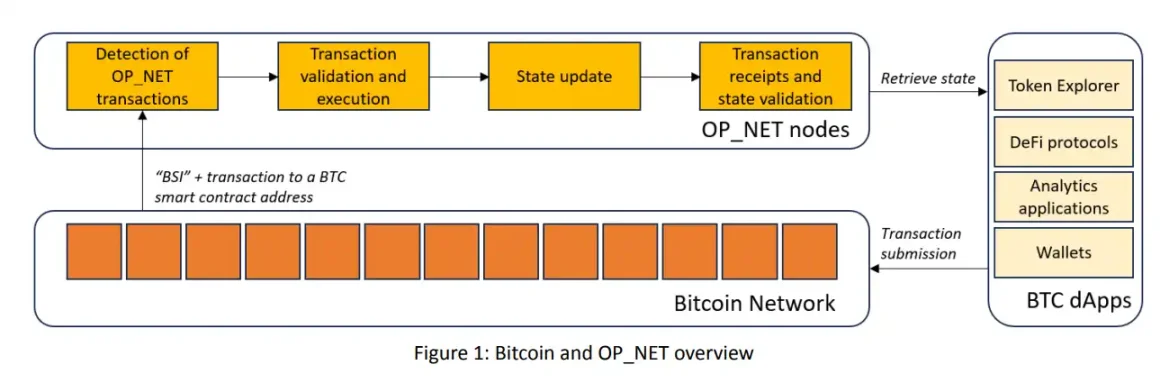

简析两种最新比特币智能合约实现方案:OP_NET与Arch有何区别?

简析两种最新比特币智能合约实现方案:OP_NET与Arch有何区别?作者:Cookie过去半个月,OP_NET 与 Arch 这两个比特币主网上的智能合约实现方案引发了较多的讨论。有意思的事情是,OP_NET 这个名字与大家熟悉的 OP_CAT 很像,都以「OP_」开头,具有很强的、让大家认为这哥俩差不多的迷惑性。所以,在开篇要和大家先提一嘴 OP_CAT。首先,OP_CAT 是比特币操作码,从去年开始有以「量子猫」Quantum Cats,也就是「大巫师」Taproot Wizards 的创始人 Udi Wertheimer 为首的社区力量一直在呼喊要「复活」OP_CA

-

争议不断,以太坊正在失去“万链之王”的权威

争议不断,以太坊正在失去“万链之王”的权威作者:Climber,金色财经近期围绕以太坊的话题和争议越来越多,不仅 Vitalik 本人需要下场解释观点,就连以太坊基金会也要发布公告来平息社区的质疑声。在本轮牛市周期中,以太坊的表现可谓平平。而美国以太坊现货 ETF 的通过也并未让 ETH 走势如投资者期待般爆发,相反却在币价方面越走越低。这就不免让有着「万链之王」美誉的以太坊逐渐失去投资者和社区的尊重,进而质疑起有关以太坊的方方面面。争议不断,以太坊亟需重塑权威最近一段时间以来社区成员对 Vitalik 言论观点、以太坊基金会乃至以太坊生态系统的

-

从《黑神话:悟空》谈起,GameFi何时能取得真经?

从《黑神话:悟空》谈起,GameFi何时能取得真经?作者:YBB Capital Researcher Zeke前言本文是市场垃圾时间中的一些闲聊,需要对传统游戏市场有一定程度了解。大家可以把这篇文章当作日记或者随想观看,这些只是我在游玩《黑神话:悟空》之后对GameFi的一些粗浅思考,以及对这个赛道未来的看法。一、游戏科学的九九八十一难三天全网销量破千万、Steam玩家同时在线峰值破235万、多家品牌联名周边销售爆火、国家级媒体多次采访、多个游戏取景地可凭游戏通关记录终身免费进入、86版《西游记》YouTube观看量超400万。以上,是《黑神话:悟空》上

-

Gavin Wood:如何防止女巫攻击进行有效空投?

Gavin Wood:如何防止女巫攻击进行有效空投?演讲:Gavin WoodGavin 近期一直在关注的女巫攻击(civil resistance)的问题,PolkaWorld 回顾了 Gavin Wood 博士在 Polkadot Decoded 2024 上的主题演讲,想要探究 Gavin 在如何防止女巫攻击上的一些见解。什么是女巫攻击?你们可能知道,我一直在研究一些项目,我在编写灰皮书,专注于 JAM 项目,也在这个方向上做了一些代码的工作。实际上,在过去的两年时间里,我一直在思考一个非常关键的问题,这个问题在这个领域中非常重要,那就是如何防止女巫

-

市场热议,链抽象将成加密新叙事?

市场热议,链抽象将成加密新叙事?2024年,加密货币领域的技术创新持续加速,链抽象(Chain Abstraction)逐渐成为行业内的焦点。链抽象技术的核心在于通过隐藏底层技术的复杂性,让用户能够更加便捷地在多个区块链之间进行操作。传统的区块链技术通常要求用户掌握不同链的操作流程,并需要应对跨链操作中的技术难题,这极大地吸引了新用户的进入。而链抽象的出现,则为这些问题提供了有效的解决方案,成为Web3建设不可忽视的重要一环。01、什么是链抽象及其作用链抽象能够将不同的区块链之间的差异整合在一个统一的操作界面中,使得用户只需一个账户即可

-

今日日报|马斯克和特斯拉赢得“被指控操纵狗狗币”的诉讼;稳定币支付平台Bridge完成5800万美元融资

今日要闻提示:马斯克和特斯拉赢得驳回指控他们操纵狗狗币的诉讼OpenAI和Anthropic已同意将其主要新AI模型在发布前共享给美国政府OKX将上线Hamster Kombat(HMSTR)现货交易X平台纽约总部将于9月13日关闭,预计将迁往得州萨尔瓦多总统布克尔成为《时代》杂志最新一期封面人物稳定币支付公司Bridge完成5800万美元融资数据:MATIC、SHIB、UNI代币头部地址持仓均超50%网龙今年上半年通过出售2.9亿元的加密货币,获利5100万元人民币监管消息美国众议院计划在9月举行多场加

- 成交量排行

- 币种热搜榜

Pepe

Pepe dogwifhat

dogwifhat 泰达币

泰达币 比特币

比特币 以太坊

以太坊 狗狗币

狗狗币 Solana

Solana USD Coin

USD Coin Shiba Inu

Shiba Inu 瑞波币

瑞波币 First Digital USD

First Digital USD Sui

Sui 艾达币

艾达币 币安币

币安币 Tellor

Tellor RAY

RAY EOS

EOS FIL

FIL DYDX

DYDX LUNC

LUNC MASK

MASK ETC

ETC CFX

CFX DOT

DOT CRV

CRV